DeepSeek di VPS Sendiri? Bisa, Cuma 30 Menit!

Ketagihan chat sama DeepSeek tapi risih data dikirim ke luar? Tenang, kamu bisa nge-host DeepSeek R1 di VPS sendiri pakai Ollama. Tanpa API key, tanpa batasan request, full control.

Di tutorial ini gue bakal bawa kamu dari 0: siapin VPS Ubuntu, install Ollama, download model, sampai ngobrol lewat antarmuka web. Siapin kopi, duduk manis, langsung eksekusi.

Kenapa Harus DeepSeek + Ollama di VPS?

DeepSeek R1 sekarang jadi primadona karena performa nyaris setara OpenAI o1 tapi open-source. Kombinasi sama Ollama bikin kamu bisa jalanin model itu di mesin sendiri—bebas biaya per-request, bebas khawatir data leak.

VPS dipilih biar bisa diakses kapan aja dari mana aja, bahkan buat tim. Beda sama PC rumahan yang harus nyala 24 jam. Dengan spes segini, kamu bisa handle puluhan user sekaligus tanpa lag.

Spesifikasi Minimal & Estimasi Biaya

Kok gak bisa di 2 GB RAM? Karena model 7-butuh sekitar 4-5 GB VRAM (kalau pakai CPU, di-RAM). Jadi 16 GB itu sweet spot. CPU 4 core buat inference cepat; kurang dari itu masih jalan tapi response bisa 2-3× lebih lama.

Kalau belum punya VPS, cari provider yang support Ubuntu 22/24 dan bisa pasang custom ISO. Budget IDR 150k/bulan cukup untuk KVM 4 GB, tapi tetap disarankan 16 GB biar nyaman. SSD NVMe juga wajib, soalnya model 7-butuh sekitar 5 GB dan Ollama butuh swap kalau RAM mepet.

Keamanan & Izin Port

Ollama pakai 8080 default. Pastikan kamu buka port itu di firewall cloud & OS. Kalau mau aman, pasang SSL + reverse proxy (nginx) biar bisa HTTPS dan custom domain. Tutorial lanjutan ada di sini.

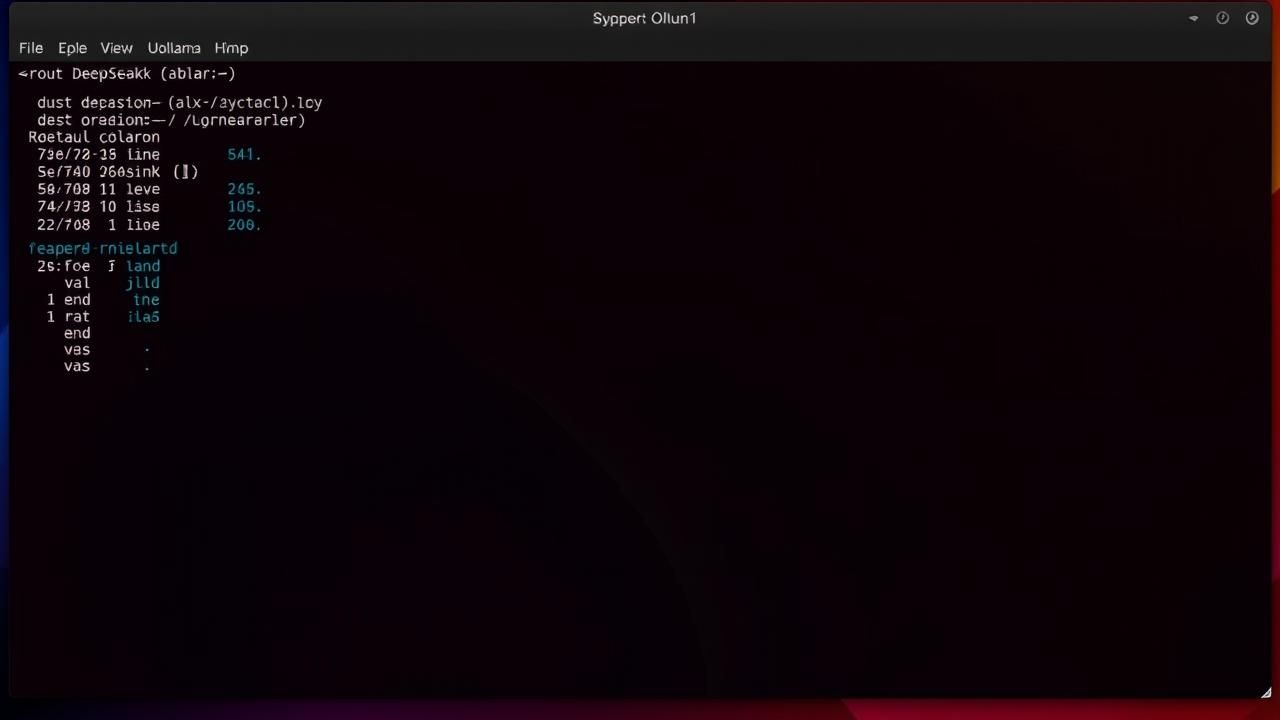

Step-by-Step Install Ollama & DeepSeek R1

- SSH ke VPS:

ssh root@IP_KAMU - Update sistem:

apt update && apt upgrade -y - Install dependensi:

apt install curl python3 python3-venv -y - Download Ollama:

curl -fsSL https://ollama.com/install.sh | sh - Pull model 7b:

ollama pull deepseek-r1:7b(tunggu ±5 menit) - Buat venv WebUI:

python3 -m venv ~/ollama-webui && source ~/ollama-webui/bin/activate - Install WebUI:

pip install open-webui - Jalanin di background pakai screen:

screen -S ollama -dm open-webui serve --host 0.0.0.0 --port 8080 - Buka browser:

http://IP_VPS:8080, daftar akun admin.

Selesai. DeepSeek R1 siap diajak ngobrol. Mau ganti model? Tinggal ollama pull nama-model:tag lalu pilih di dropdown WebUI.

Optimasi Biaya & Performa

- Pakai model 1.5butuk testing hemat RAM (4 GB cukup).

- Set

OLLAMA_KEEP_ALIVE=24hbiar gak reload model tiap request. - Tambah swap 8 GB sebagai buffer kalau RAM 16 GB sering full.

- Monitor GPU usage pakai

htopataunvidia-smikalau pake GPU cloud.

Kesimpulan

Dengan satu baris perintah kamu sudah punya AI chat sendirian di VPS. DeepSeek R1 + Ollama = kombinasi cepat, murah, bebas iklan. Mulai sekarang riset, nulis kode, atau bikin FAQ internal tim bisa langsung di server sendiri.

Kalau udah berhasil, lanjut ke step berikutnya: integrasi API ke aplikasi atau pasang authentication multi-user. Semua panduan ada di blog ini—scroll terus, jangan lupa share ke dev-rekan kamu.

FAQ

7butuh RAM 8-16 GB, hasil lebih akurat. 1.5butuh RAM 4 GB, cocok untuk testing atau user sedikit.

Bisa, pakai image official ollama/ollama lalu bind mount model folder. Lebih rapi tapi butuh setup volume.

Cek firewall cloud & UFW, pastikan port 8080 terbuka. Lalu cek status screen: screen -r ollama.