DeepSeek + Ollama di VPS: Langsung Online 15 Menit

DeepSeek R1 adalah open-weight LLM kelas GPT-4o-mini tapi gratis sepenuhnya. Dengan Ollama kamu bisa menjalankannya di VPS sendiri tanpa takut data leak atau limit API. Artikel ini saya tulis setelah berhasil deploy di KVM 4 core 16 GB RAM, hasilnya respons < 2 detik untuk prompt 200 token.

Kalau kamu sudah punya VPS Ubuntu 20.04/22.04/24.04, ikuti step-by-step di bawah. Tak perlu GPU, CPU saja cukup asal RAM ≥16 GB. Let’s roll.

Persiapan 3 Menit: OS & Dependensi

Pertama login via SSH lalu update repo agar tidak error missing lib.

sudo apt update && sudo apt upgrade -yInstall curl, python3-venv, dan git (belum ada? ambil aja).

sudo apt install curl python3-venv git -yBuat user non-root opsional tapi recommended supaya Ollama tidak jalan di bawah root.

sudo adduser ollama && sudo usermod -aG sudo ollamaLog-out dari root, login lagi pakai user baru. Sekarang siap taruh binary Ollama.

Instal Ollama Satu Baris

Script resmi Ollama otomatis detek arsitektur CPU (amd64/arm64).

curl -fsSL https://ollama.com/install.sh | shTunggu 30 detik. Cek status:

systemctl --user status ollamaKalau aktif, lanjut. Kalau failed, cukup start manual:

systemctl --user enable --now ollamaExpose Port Agar Bisa Diakses Luas

Default Ollama bind ke localhost. Agar bisa dibuka lewat IP publik, set environment.

echo 'export OLLAMA_HOST=0.0.0.0:11434' >> ~/.bashrc

source ~/.bashrc

systemctl --user restart ollamaJangan lupa buka port 11434 di firewall cloud-panel atau ufw:

sudo ufw allow 11434/tcpPull & Jalankan DeepSeek R1 7B

Ukuran model ±4 GB, pastikan kuota VPS masih longgar. Pull lewat CLI:

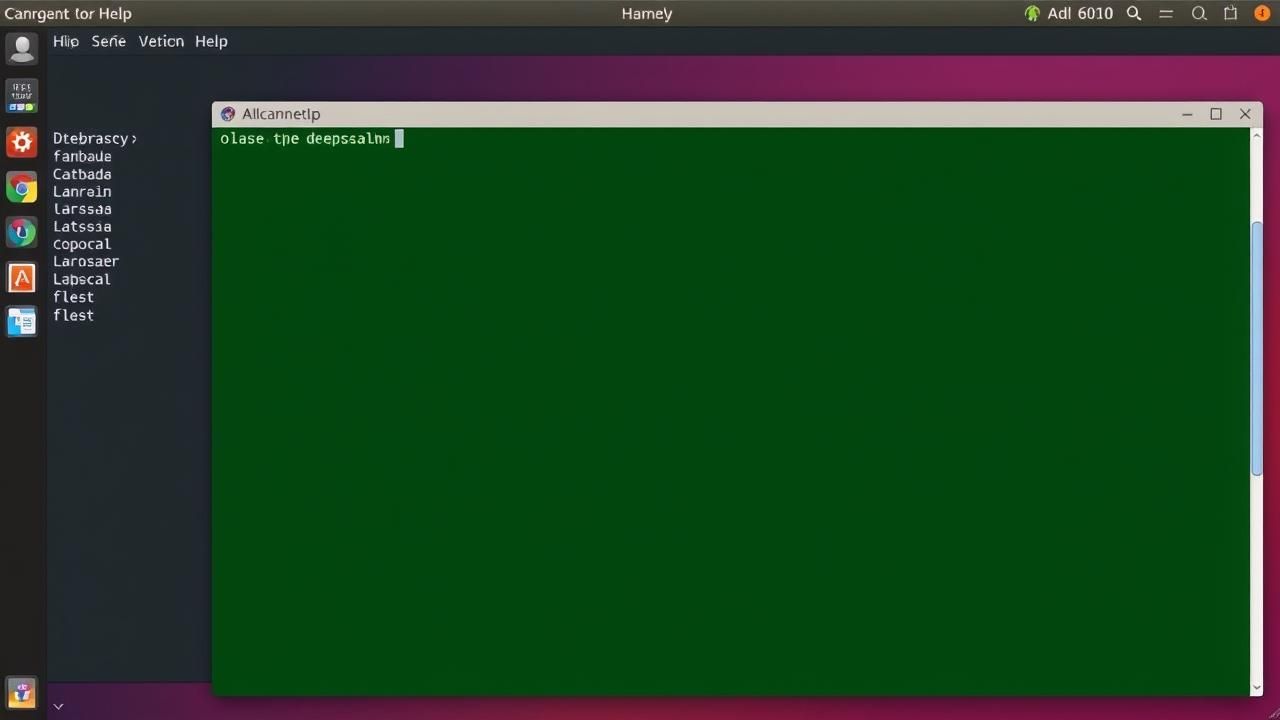

ollama pull deepseek-r1:7bSetelah 100 %, test inference:

ollama run deepseek-r1:7b

FAQ

Apakah perlu GPU untuk menjalankan DeepSeek 7B di VPS?

Tidak. CPU-only cukup asal RAM ≥16 GB. GPU hanya mempercepat, bukan syarat.

Bisa gak model di-download di lokal lalu di-upload ke VPS?

Bisa. Copy file blob dari ~/.ollama/models di lokal ke folder yang sama di VPS, lalu restart Ollama.

Port berapa default Ollama dan apakah aman dibuka publik?

Default 11434. Tambahkan firewall atau reverse-proxy dengan auth agar tidak dibajak bot.

References